.jpeg)

Wenn Sie jemals "Pinterest Scraper" in eine Suchmaschine eingegeben haben, wissen Sie bereits, wonach Sie suchen: eine zuverlässige, skalierbare Möglichkeit, Pinterest-Daten abzurufen und sie zu nutzen. Ob für Trendforschung, Wettbewerbsbeobachtung oder zur Speisung einer KI-Pipeline – das Endziel bleibt immer dasselbe: saubere, nutzbare Pinterest-Daten, die konsistent geliefert werden.

Was jedoch stark variiert, ist der Weg, den die Menschen wählen, um mit dem Scraping von Pinterest zu beginnen.

Einige greifen zu einem Scraper. Andere entdecken, dass eine speziell entwickelte API von Anfang an die klügere Wahl war. Dieser Artikel beleuchtet beide Wege: wie sie in der Praxis tatsächlich aussehen, wo das Scraping scheitert und welches Tool besser geeignet ist, um Pinterest zu scrapen.

Kurzüberblick

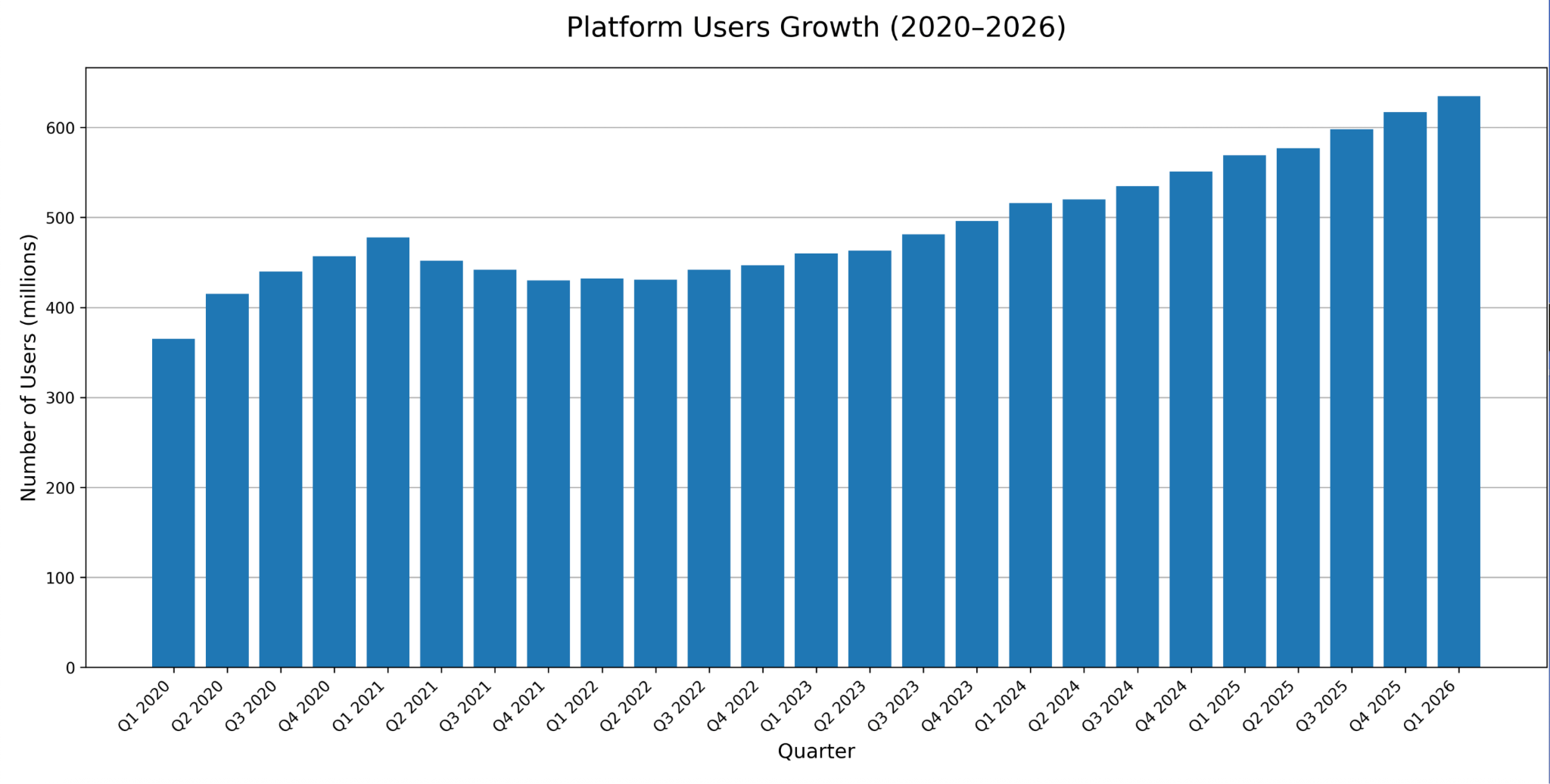

- Der offizielle Quartalsbericht Q4 2025 von Pinterest verzeichnete 619 Millionen monatlich aktive Nutzer und ein Umsatzwachstum von 14%, was es zu einer Datenquelle macht, die für jeden ernsthaften Marktforscher, Trendanalysten oder Content-Strategen von Bedeutung ist.

- Alle drei gängigen Scraping-Ansätze (manuelle Skripte, Open-Source-Tools und Drittanbieterdienste) analysieren das Frontend-HTML von Pinterest, was bedeutet, dass jede Plattformaktualisierung sie zum Scheitern bringen kann.

- Pinterest-Scraper ahmen das Verhalten von Browsern nach, um Plattformdaten zu extrahieren; sie haben eine niedrige Eintrittsbarriere, aber Pinterest bekämpft aktiv automatisierte Aktionen, was es schwierig macht, echtes Wachstum zu erzielen.

- Die Automatisierung eines Scrapers zu einem Bot löst das Problem nicht: Sie skaliert es und bringt ein höheres Risiko der Erkennung, schwerere Infrastruktur und steilere laufende Kosten mit sich.

- Eine Social Media API von Data365 liefert dieselben Pinterest-Daten sauberer, schneller und zuverlässiger, jedoch ohne den Ingenieuroverhead, unvorhersehbare Kosten oder operationale Fragilität von Scrapers.

Pinterest Scraper: Warum Entwickler zuerst danach greifen

Ein Pinterest-Scraper ist ein Programm, das Daten von Pinterest extrahiert, indem es simuliert, wie ein Browser oder Benutzer mit der Plattform interagiert. Im Hintergrund funktioniert es typischerweise über eines von drei Mechanismen:

- Parsing des Roh-HTML von Pinterest-Seiten

- Abfangen von HTTP-Anfragen, um Daten zu erfassen, bevor sie gerendert werden

- Ausführen eines Headless-Browsers wie Puppeteer oder Playwright, um JavaScript auszuführen und das resultierende DOM zu scrapen

Es gibt leistungsstarke Anwendungsfälle, die Unternehmen zum Scraping von Pinterest treiben. Ideen, die sich über die Plattform verbreiten, müssen verfolgt werden, um zu sehen, welcher visuelle Inhalt an Bedeutung gewinnt, was Wettbewerber anheften und welche Konten in einer Kategorie Einfluss haben.

Pinterest, mit seinen 619 Millionen monatlich aktiven Nutzern im Q4 2025 und einer Wachstumsrate von 14%, ist einfach eine zu bedeutende Datenquelle, um sie zu ignorieren (insbesondere für Marken, die in den Bereichen Mode, Wohnen, Schönheit, Essen und Lifestyle tätig sind, wo die Plattform dominiert).

Warum fühlt sich ein Scraper also wie der natürliche erste Instinkt an? Weil die Eintrittsbarriere niedrig ist. Ein Entwickler kann ein einfaches Skript an einem Nachmittag schreiben, es auf eine Pinterest-URL richten und innerhalb von Stunden mit dem Abrufen von Daten beginnen – kein Genehmigungsprozess, keine API-Schlüssel, kein Warten. Für einen schnellen, einmaligen Datenabruf kann es so wirken, als ob es funktioniert.

Die Probleme beginnen in dem Moment, in dem Sie möchten, dass es weiterhin funktioniert.

Wege, Pinterest zu scrapen und warum die meisten davon scheitern

Es gibt drei Hauptwege, die Entwickler wählen, wenn sie sich entscheiden, Pinterest-Daten abzurufen. Lassen Sie uns jeden einzelnen aufschlüsseln.

- Manuelle Skripte sind benutzerdefinierte Python- oder Node.js-Code-Schnipsel, die Pinterest-URLs ansteuern und die Antwort analysieren.

- Externe Scraper-Dienste sind unabhängige Tools, die die Scraping-Infrastruktur in Ihrem Namen verwalten und die technische Komplexität gegen eine Abonnementgebühr abstrahieren.

- Offizielle oder Drittanbieter-APIs sind strukturierte Schnittstellen, die direkten, dokumentierten Zugang zu Plattformdaten bieten, ohne dass Infrastrukturmanagement und simuliertes Browserverhalten erforderlich sind.

Die Vergleichstabelle unten zeigt die Funktionalitätsmerkmale jedes Tools, damit Sie entscheiden können, ob Sie Pinterest-Scraping ausprobieren oder direkt auf eine stabile API-Abfrage setzen möchten, beispielsweise mit der Data365 Social Media API.

| Kriterium | Manuelles Skript | Drittanbieterdienste | Data365 API |

|---|---|---|---|

| Einrichtungszeit | ⚡ Schnell – ein einfaches Skript kann in Stunden laufen | 🕑 Mittel – Onboarding variiert | ✅ Schnell – stabile Endpunkte, klare Dokumentation, einmal integrieren und fertig |

| Wartungsaufwand | ❌ Hoch – bricht bei jedem Frontend-Update von Pinterest | ⚠️ Mittel – der Anbieter kann einen Teil davon übernehmen oder auch nicht | ✅ Keine – Infrastruktur und Updates werden vollständig auf der API-Seite verwaltet |

| Zuverlässigkeit im großen Maßstab | ⚠️ Mittel – gut für kleine Mengen, aber wird unvorhersehbar schlechter, wenn die Anfragerate steigt | ⚠️ Mittel – die Zuverlässigkeit hängt vollständig von der Betriebszeit des Anbieters ab | ✅ Hoch – für Produktionslasten mit 99% Betriebszeit ausgelegt |

| Datenqualität | ❌ Inkonsistent – fehlende Felder, defekte URLs und Formatabweichungen | ⚠️ Mittel – unvollständige oder veraltete Daten sind eine häufige Beschwerde | ✅ Hoch – strukturierte, saubere, konsistent formatierte JSON-Ausgabe |

| Infrastrukturkosten | ⚠️ Anfechtbar – niedrig zu Beginn, aber ohne zusätzliche Dienste | ⚠️ Mittel – nutzungsabhängige oder komplizierte Preismodelle auf Basis von Recheneinheiten | ✅ Vorhersehbar – ein kreditbasiertes Abonnementmodell, keine versteckten Kosten |

| Support & SLA | ❌ Keine – Sie sind für jeden Fehler, jede Behebung und jede Alarmierung um 2 Uhr morgens verantwortlich | ⚠️ Variiert – einige Anbieter bieten Supportstufen an, aber SLAs sind selten durchsetzbar | ✅ Dedizierter Support mit klaren Serviceverpflichtungen und jemandem, den man anrufen kann, wenn es darauf ankommt |

Die Tabelle erzählt eine klare Geschichte: Je weiter Sie sich von einem manuellen Skript zu einer strukturierten API bewegen, desto zuverlässiger, skalierbarer und kostenvorhersehbarer wird Ihre Datenpipeline.

Wenn Sie also nicht mit weniger zufrieden sind und direkt zu einer funktionalen Möglichkeit zur Abfrage von Pinterest-Daten gelangen möchten, ist Data365 hier, um Ihnen zu helfen. Vereinbaren Sie einen Anruf mit uns, erhalten Sie Ihr persönliches Token und Dokumente und beginnen Sie, die Informationen abzurufen, die Sie benötigen.

Der nächste logische Schritt, den viele Entwickler unternehmen, besteht darin, den Scraping-Prozess vollständig zu automatisieren, indem sie ihn in einen Bot umwandeln. Und genau hier wird es erheblich komplizierter.

Pinterest Scrape Bot: Wie Automatisierung die Dinge schwieriger, nicht einfacher macht

Wenn ein Scraper allein nicht schnell genug ist, scheint der logische nächste Schritt darin zu bestehen, ihn in einen Bot zu verwandeln: den Scraping-Prozess zu automatisieren, sodass er kontinuierlich, in großem Maßstab und ohne menschliches Eingreifen läuft. Ein Pinterest-Scrape-Bot tut genau das – er sendet Anfragen parallel, navigiert automatisch durch Seiten und versucht, Daten in großen Mengen zu ernten.

Das Problem ist, dass alles, was am Scraping bereits schwierig war, dramatisch schwieriger wird, wenn Sie Automatisierung hinzufügen.

Die Bot-Erkennungssysteme von Pinterest sind darauf abgestimmt, genau dieses Verhalten zu identifizieren. Ungewöhnliche Anfragevolumina, nicht-menschliche Navigationsmuster, wiederholter Zugriff von derselben IP und verdächtige Sitzungszeiten sind alles Signale, die die Erkennung auslösen. In dem Moment, in dem ein Bot markiert wird, eskalieren die Konsequenzen: IP-Sperren, Kontosperrungen, CAPTCHAs, die die Pipeline unterbrechen, und zunehmend aggressive Fingerabdrücke, die das Rotieren zu einer neuen Identität bei jedem Mal erschweren.

Der Ingenieuroverhead ist nicht trivial. Branchendaten deuten darauf hin, dass die Wartung eines Scraping-Bots im großen Maßstab die Äquivalenz von 5 bis 10 Stunden Ingenieurzeit pro Woche nur für die Pflege erfordert – Reaktion auf Erkennungsmuster, Behebung defekter Abläufe und Anpassung an Plattformänderungen. Das ist noch bevor Sie die tatsächliche Infrastruktur berücksichtigen, die ihn betreibt.

Vergleichen Sie das mit einem API-Aufruf, der strukturierte, saubere, zuverlässig formatierte Daten in Minuten zurückgibt – und die Komplexität beginnt weniger wie eine Herausforderung auszusehen, die es zu lösen gilt, und mehr wie ein Problem, das es zu vermeiden gilt. Der dreistufige Abruffluss der Data365 Social Media API ist ein gutes Beispiel dafür, wie diese Einfachheit aussieht, wenn sie für die Produktion entwickelt wurde. Lassen Sie es uns in Aktion sehen.

Pinterest Scraping Automation: Wie zuverlässiger Abruf von Pinterest-Daten tatsächlich aussieht

Jedes Unternehmen, das auf Pinterest-Daten angewiesen ist, benötigt dasselbe von seiner Pipeline: einen Prozess, der konsistent läuft, saubere Ergebnisse zurückgibt und keinen Ingenieur in Bereitschaft erfordert. Das ist nicht das, was die Automatisierung des Pinterest-Scrapings liefert, aber genau das tut eine gut strukturierte API.

Die Data365 Social Media API verwendet einen einfachen dreistufigen Ablauf, um öffentliche Pinterest-Pin-Daten abzurufen. So sieht das in der Praxis aus:

1. Daten über POST-Anfrage aktualisieren

2. Den Status der Aufgabe mit GET-Anfrage überprüfen

3. Die Ergebnisse über GET-Anfrage abrufen

So sieht eine erfolgreiche Antwort aus:

Die Antwort kommt als sauberes, konsistent strukturiertes JSON mit Pin-Metadaten, Engagement-Metriken und öffentlichen Profildetails in einem vorhersehbaren Payload zurück. Kein Parsing, keine defekten Felder, keine Überraschungen.

Was können Sie darauf aufbauen? Das ist der interessante Teil. Sobald die Daten zuverlässig fließen, liegen die Automatisierungsmöglichkeiten ganz bei Ihnen.

- Trendüberwachungs-Dashboard

Planen Sie tägliche API-Aufrufe über eine Reihe von Ziel-Pins oder Wettbewerbs-Boards, leiten Sie die Engagement-Metriken in ein Tool wie Tableau oder Google Looker Studio und Sie haben ein Live-Visual-Intelligence-Dashboard, das sich selbst aktualisiert.

- Wettbewerber-Inhalts-Tracker

Richten Sie ein leichtgewichtiges Python-Skript ein, das wöchentlich öffentliche Pin-Daten von Wettbewerberprofilen abruft, die Ergebnisse in einer Datenbank speichert und jeden Pin kennzeichnet, der einen Engagement-Schwellenwert überschreitet. Sie erhalten ein frühes Signal dafür, was in Ihrer Nische ankommt, bevor es zu einem Trend wird, dem alle anderen bereits nachjagen.

- E-Commerce-Leistungsmonitor

83% der Pinterest-Nutzer haben aufgrund von Inhalten, die sie auf der Plattform entdeckt haben, einen Kauf getätigt – was das Engagement mit Pins zu einem bedeutenden Indikator für Kaufabsicht macht. Verbinden Sie die API-Antwort mit Ihrem Produktkatalog, und Sie können automatisch Pin-Speicher- und Klickdaten mit der SKU-Leistung korrelieren, was Ihrem Merchandising-Team eine direkte Verbindung von Pinterest-Aktivitäten zu Bestandsentscheidungen ermöglicht.

Der Punkt ist nicht, dass diese Workflows komplex zu erstellen sind – es ist, dass sie nur möglich sind, wenn die Daten, die ihnen zugrunde liegen, stabil und vorhersehbar sind. Ein Scraper kann Ihnen das nicht bieten. Eine API kann es.

Also, zu welchem Team gehören Sie: einem Scraper- oder einem API-Team? Wenn Sie frische Pinterest-Daten konsistent, schnell und zuverlässig abrufen möchten, zögern Sie nicht, uns jetzt zu kontaktieren. Wir werden alle Details Ihres spezifischen Projekts besprechen und die beste Lösung finden.

Extrahieren Sie Daten aus vier sozialen Netzwerken mit der Data365-API

Fordern Sie eine kostenlose 14-Tage-Testversion an und erhalten Sie mehr als 20 Datentypen

.jpg)

.svg)

.svg)

.svg)

.svg)

.svg)

.svg)