Marketer und Analysten fühlen sich aus gutem Grund zu Reddit hingezogen: ungefiltertes Feedback, neueste KI-Veröffentlichungen, lokale Einblicke aus erster Hand — das ist alles wie Goldstaub. Reddit Kommentar-Scraper scheinen der Abkürzungsweg zu all dem zu sein — klicken, ziehen Sie Tausende von Kommentaren für Sentiment-Analysen oder Wettbewerbsforschung. Aber die Risse zeigen sich schnell. IP-Sperren, kostspielige Proxys und Plattform-Updates bedeuten einen weiteren Abend, an dem kaputte Selektoren repariert werden müssen.

Dieser Leitfaden für 2026 durchbricht den Lärm. Wir werden durchgehen, wann ein Reddit Kommentar-Scraper tatsächlich Sinn macht (schnelle Prototypen, einmalige Experimente), wo er scheitert (Anti-Bot-Systeme, Wartungsspiralen) und warum APIs der intelligentere langfristige Weg sind.

Wir werden auch zwei Reddit Kommentar API-Optionen entdecken: die offizielle Reddit API und die Social Media API von Data365, die speziell für die unternehmensweite Kommentar-Extraktion entwickelt wurde, sodass Sie mit einem klaren Bild davon, welches Tool für welchen Job geeignet ist, herauskommen.

Schnelle Übersicht

- Verwenden Sie einen Reddit Kommentar-Scraper nur, wenn: Sie weniger als 100 Kommentare pro Woche benötigen und mit wöchentlichen Wartungszyklen leben können.

- Wählen Sie die offizielle API von Reddit, wenn: Sie eine benutzerorientierte App entwickeln, die OAuth-Authentifizierung benötigt, Echtzeitdaten für leichte Überwachung wünscht und innerhalb von 100 Anfragen pro Minute arbeiten kann.

- Wählen Sie Social Media API, wenn: Sie historische Kommentararchive, verschachtelte Antwort-Threads, Hochvolumenauszüge oder strukturierten JSON-Ausgaben benötigen, ohne sich mit HTML-Parsern herumschlagen zu müssen.

Warum funktionieren Reddit Kommentar-Scraper nicht in jeder Situation?

Die Kommentarabschnitte von Reddit sind eine Goldmine für Marketer: rohe, Echtzeit-Einsichten zu Produkten, Trends und Wettbewerbern. Scraper versprechen sofortigen Zugang zu all dem, aber ist das real? Für kleine Aufgaben liefern sie. Aber wenn sie zu einer Analyse über Subreddits hinweg gedrängt werden (z. B. 50k+ Kommentare), wird die Versuchung zur Quälerei.

Wenn es scheint, dass die Aufrechterhaltung eines Scrapers mehr Mühe als Nutzen bringt, zeigen wir Ihnen gerne eine bessere Methode. Buchen Sie einen 15-minütigen Anruf mit unserem technischen Team, um zu erfahren, wie Data365 in Ihre Reddit-Datenstruktur passen kann.

No-Code-Scraper: Der einfache Einstiegspunkt

Reddit Kommentar-Scraper wie WebScraper, Octoparse oder ParseHub sind wirklich nützlich für schnelle Prototypen. Starten Sie die Browsererweiterung, skizzieren Sie den Kommentarbaum (Autor, Text, Upvotes, Antworten) und exportieren Sie eine CSV in weniger als zehn Minuten. Keine Server, keine Skripte. Nur visuelle Selektoren, die Threads herausziehen. Für einen Marketer, der die Markenstimmung aus einem viralen AMA vor einem Produktlaunch bewerten muss, erledigt diese Art von Setup die Aufgabe.

Aber die Räder fallen schnell ab. Die dynamische Ladefunktion von Reddit (unendliches Scrollen, lazy-loaded Antworten) täuscht statische Selektoren. Wenn Sie über 5k Kommentare hinausgehen, beginnen CAPTCHAs zu fluten, Sitzungen laufen ab, und verschachtelte Threads werden vollständig verworfen. Kostenlose Pläne sind auf 10k Zeilen pro Monat begrenzt, was bei einer nachhaltigen Kampagne nicht weit reicht.

Browsererweiterungen und hybride Tools: Plug-and-Play-Appell

Web-Scraping-Erweiterungen gehen einen Schritt weiter. Ein-Klick-Setup, DOM-basiertes Kommentarparsing, und Sie können Ihre hundert Kommentare ohne großen Aufwand erhalten. Kombinieren Sie sie mit Zapier, um automatisch in Google Sheets zu exportieren, und Sie haben ein vernünftiges wöchentliches Überwachungssetup.

Das Problem? Skalierung. Die Anti-Bot-Upgrades von Reddit 2025, wie Verhaltensfingerabdrücke und JavaScript-Herausforderungen, beginnen, IPs während des Betriebs zu sperren. Proxys helfen eine Weile, aber das Ketten von 100+ kostet 50-100 USD pro Monat und verlangsamt alles, was für einen Drittanbieter-Reddit-Kommentar-Scraper einen zu hohen Preis darstellt.

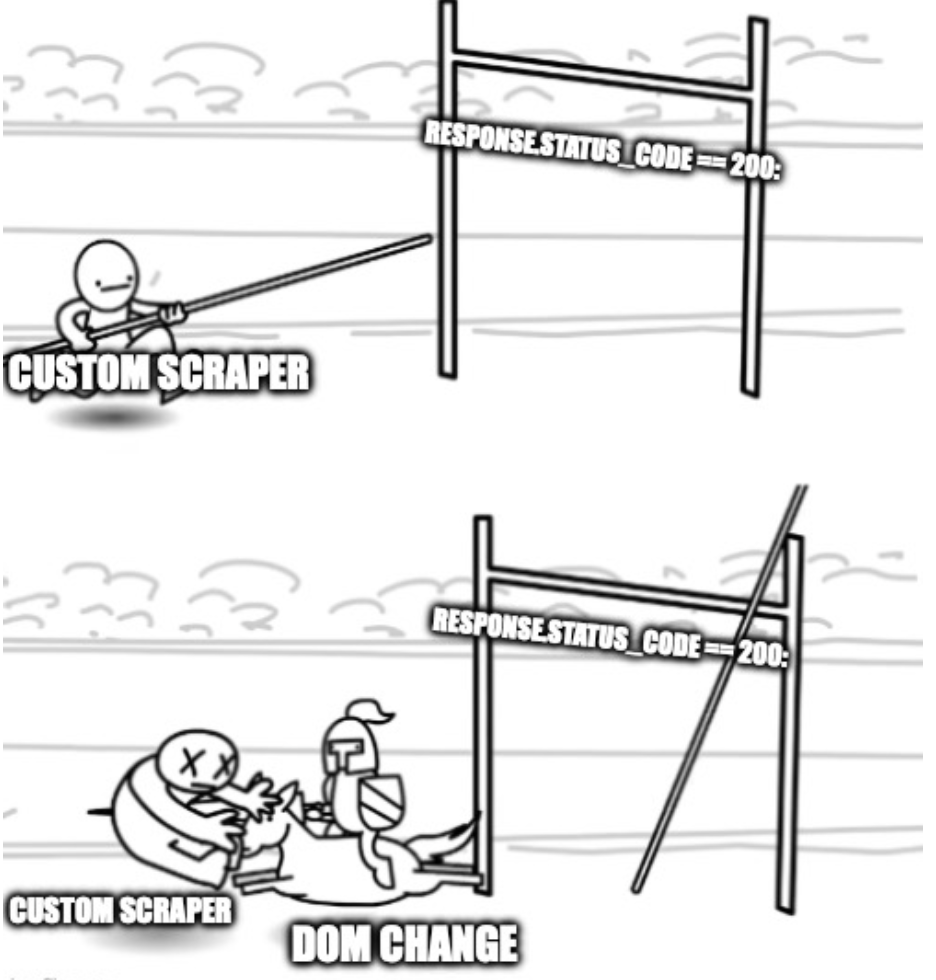

Python Reddit Kommentar-Scraper: Leistung mit Schmerz

Für technische Teams ist Python der natürliche Schritt. Bibliotheken wie BeautifulSoup, Scrapy oder PRAW ermöglichen es Ihnen, wirklich fähige Extraktoren zu erstellen. Planen Sie es so, dass es täglich die Threads von r/business abruft und alles in Pandas zur Analyse leitet.

Aber die Wartung ist unerbittlich. Die Ratenbegrenzung von Reddit und das Roulette der Selektoren nagen schnell am Momentum. Das Muster ist konsistent: Basierend auf Python ziehen Reddit Kommentar-Scraper Sie mit Geschwindigkeit an, lassen Sie jedoch bei hohem Volumen im Stich. Hier kommen APIs ins Spiel.

Reddit Kommentar APIs: Der effiziente Weg nach vorne

APIs tauschen die Wildwest-Energie des Scrapings gegen strukturierte Zuverlässigkeit aus — stabile Endpunkte, die sauberes JSON ohne Aufwand zurückgeben. Im Jahr 2026 sind sie der professionelle Standard, der Effektivität mit der Art von Skalierung kombiniert, die tatsächlich Produktions-Workflows dient.

Offizielle Reddit API im Jahr 2026: Solide Grundlagen, strenge Grenzen

Die offizielle Reddit API, die nach dem APIgate-Skandal von 2023 gründlich überarbeitet wurde, kommt mit klaren Nutzungsbedingungen für 2026: OAuth 2.0-Authentifizierung erforderlich, 100 Abfragen pro Minute und Client-ID, kein Weiterverkauf von Rohdaten, die von Nutzern generiert wurden. Kostenlos für nicht-kommerzielle Nutzung; kommerzieller Zugang beginnt bei 0,24 USD pro 1.000 Aufrufen.

Sie ist wirklich forschungsfreundlich. Die PRAW-Bibliothek von Python macht die Integration einfach, und das Abrufen von 1k Kommentaren für eine akademische Sentiment-Studie oder leichte Überwachung ist unkompliziert.

Trotzdem stoßen Marketer auf Wände. Ratenbegrenzungen begrenzen Massenabrufe unter idealen Bedingungen auf etwa 60k Kommentare pro Stunde; es gibt keine Massenhistorischen Endpunkte, und OAuth wird in teamorientierten Workflows unhandlich.

Für Kampagnen, die eine Aggregation über mehrere Subreddits oder historische Trendanalysen erfordern, funktioniert die native API von Reddit gut als Prototyp-Tool, hält jedoch in einer Produktionsumgebung nicht stand.

Data365 Social Media API: Unternehmensweite Skalierung für Reddit-Meisterschaft

Die Social Media API von Data365 ist für Teams konzipiert, die bereits auf die oben genannten Grenzen gestoßen sind. Anstatt die Komplexität der Infrastruktur selbst zu verwalten, geben Sie sie ab und konzentrieren sich auf das Wesentliche: die Daten.

Die API liefert täglich die genau benötigte Anzahl von Kommentaren über Subreddits hinweg, mit vorhersehbarer Leistung und ohne die Kopfschmerzen von Proxys — perfekt für Keyword-Mining oder Social Listening. Der Integrationsprozess ist einfach und folgt einer 3-Schritte-POST-GET-GET-Struktur. Danach erhalten Sie eine Betriebszeit von 99,9 %, stabile Endpunkte und ein engagiertes Support-Team. Was sie sowohl von Scraper als auch von der offiziellen API unterscheidet:

- Historischer Zugriff: Ziehen Sie Kommentare, solange sie in Threads verfügbar sind.

- Analytik-bereite Ausgabe: Vorstrukturierte Threads erleichtern das Einrichten von Viralitätskarten und Sentiment-Trendanalyse erheblich.

- Transparente Preisgestaltung: 14 Tage kostenlos mit vollem Potenzial und kreditbasierten Stufen.

- Engagierter Support: 24/7 technische Unterstützung zur Optimierung von Abfragen.

Dennoch ist kein einzelnes Tool für jedes Projekt geeignet. Unten haben wir eine Übersicht der Szenarien vorbereitet, in denen jeder Ansatz funktioniert — und wo nicht.

Und wenn Sie bereits herausgefunden haben, wer der Hauptakteur ist und wer nur ein NPC in diesem Datenabrufspiel ist, buchen Sie einen kurzen Anruf mit unserem Manager und beginnen Sie, Reddit-Einblicke ohne Aufwand zu ziehen.

Scraper vs. API: Wählen Sie weise basierend auf Ihrem Anwendungsfall

Die strategische Erkenntnis ist einfach: Scraper sind großartig, um eine Idee schnell zu validieren. Die offizielle API von Reddit deckt niedrigvolumige Integrationen sauber ab. Wenn Sie Zuverlässigkeit, Skalierung und Compliance in einem Produktionssystem benötigen, ist Data365 der Upgrade-Weg. Hier ist eine Tabelle, mit der Sie leicht herausfinden können, wo und wann Sie jedes Instrument verwenden sollten.

| Situation | Tool |

|---|---|

| Schnelle Wettbewerbsstimmungsprüfung (Prototyp-Subreddit-Überwachung, tägliche Kommentare) | Scraper: No-Code, 5-Minuten-Setup; schneller Export nach Sheets |

| SEO-Keyword-Analyse (über mittelgroße Subs) | API: Sauberes JSON mit Rohdaten von Reddit |

| Budgettests (schnelle Subreddit-Scans) | Scraper: Kostengünstige Prototypen in kleinem Maßstab |

| Akademische Forschung für Tech-Startups (globaler Scan über Subs) | API: Zuverlässiger Zugriff, unterstützt von engagierten Entwicklern |

| Unternehmens-Social Listening (großangelegte Subs, risikofokussiert) | API: Skalierbare Betriebszeit und historischer Zugriff |

Die Entscheidung, ob Sie einen Reddit Kommentar-Scraper oder eine API verwenden, ist eher eine Geschäftsentscheidung als eine technische Entscheidung. Ein gültiger Ausgangspunkt sind Scraper: günstig, einfach einzurichten und ausreichend für einen einzelnen Test oder um das Konzept zu beweisen.

Wenn sich Ihr Anwendungsfall jedoch erweitert (mehr Subreddits, größeres Volumen, ein Team, das vollständig von den Ergebnissen abhängt), beginnen die versteckten Kosten schnell zu steigen. Fehlerhafte Selektoren, Proxy-Rechnungen und Debugging an Wochenenden sind keine Steuer, die Sie nur einmal zahlen; sie sind eine Steuer, die Sie jedes Mal zahlen müssen.

APIs, sei es von Reddit selbst oder von einem speziellen Tool wie Data365, kompensieren diese Unsicherheit mit der wertvolleren Eigenschaft der Zuverlässigkeit, für die Sie tatsächlich planen können. Leben Sie in der Gegenwart, aber planen Sie für die Zukunft.

Verbessern Sie Ihre Reddit-Datenstrategie noch heute

Scraper bringen Sie ins Spiel. APIs halten Sie am Laufen. Wenn Sie bereit sind, über die Fragilität der wartungsintensiven Scraping-Methoden hinauszugehen, ist der Reddit-Endpunkt von Data365 der Ort, an dem Teams tatsächlich ihre beste Arbeit leisten. Beginnen Sie mit der kostenlosen Stufe, um zu testen, und skalieren Sie dann auf die benötigten Mengen für Markenüberwachung, SEO-Keyword-Entdeckung oder Wettbewerbsanalyse.

Der Einstieg dauert nur wenige Minuten:

- Vereinbaren Sie einen kurzen Anruf mit einem technischen Manager.

- Erhalten Sie Ihren persönlichen API-Schlüssel und einen detaillierten Dokumentationsleitfaden.

- Führen Sie Ihre erste Abfrage mit einem einfachen Code innerhalb einer 14-tägigen kostenlosen Testphase aus.

Was ist Ihre Herausforderung bei Reddit-Daten? Egal, ob Sie historische Trendanalysen, Echtzeit-Markenüberwachung oder verschachtelte Gesprächskartierung benötigen, Data365 hat die Infrastruktur, um das Rauschen von Reddit in umsetzbare Signale zu verwandeln — ohne die Kopfschmerzen der Extraktion.

Extrahieren Sie Daten aus vier sozialen Netzwerken mit der Data365-API

Fordern Sie eine kostenlose 14-Tage-Testversion an und erhalten Sie mehr als 20 Datentypen

.jpg)

.svg)

.svg)

.svg)

.svg)

.svg)

.svg)