マーケターやアナリストがRedditに惹かれるのは良い理由があります:フィルターのかかっていないフィードバック、最新のAIリリース、地元のインサイト — それはすべて金のような価値があります。Redditコメントスクレイパーは、それらすべてへのショートカットのように見えます — ポイント、クリック、数千のコメントを引き出して感情分析や競合調査に使用します。しかし、問題はすぐに現れます。IP禁止、高額なプロキシ、プラットフォームの更新は、壊れたセレクターを修正するための別の夕方を意味します。

この2026年のガイドは、ノイズを切り抜けます。Redditコメントスクレイパーが実際に意味を持つ時(クイックプロトタイプ、一度きりの実験)、どこで失敗するか(ボット対策システム、メンテナンスの悪循環)、そしてなぜAPIがより賢い長期的な道なのかを説明します。

また、公式のReddit APIとData365のソーシャルメディアAPIという2つのRedditコメントAPIオプションを発見し、どのツールがどの仕事に適しているかの明確なイメージを持って帰ることができます。

簡単な概要

- Redditコメントスクレイパーを使用するのは、週に100件未満のコメントが必要で、週次メンテナンスサイクルに耐えられる場合のみ。

- Redditの公式APIを選ぶのは、OAuth認証が必要なユーザー向けアプリを構築している場合、軽いモニタリングのためにリアルタイムデータが必要で、1分あたり100リクエスト内で作業できる場合。

- ソーシャルメディアAPIを選ぶのは、過去のコメントアーカイブ、ネストされた返信スレッド、高ボリュームの抽出、またはHTMLパーサーと格闘せずに構造化されたJSON出力が必要な場合。

なぜRedditコメントスクレイパーはすべての状況でうまくいかないのか?

Redditのコメントセクションはマーケターにとって金の鉱脈です:製品、トレンド、競合に関する生のリアルタイムの意見。スクレイパーはすべてへの即時アクセスを約束しますが、それは本当でしょうか?小さな仕事には効果的ですが、サブレディット全体の分析(例えば、50k以上のコメント)に押し進めると、誘惑が苦痛に変わります。

スクレイパーを維持することが価値以上の手間に思えるとき、私たちはより良い方法を示すことを喜んで行います。Data365があなたのRedditデータセットにどのようにフィットするかを学ぶために、技術チームとの15分の電話を予約してください。

ノーコードスクレイパー:簡単な入り口

WebScraper、Octoparse、ParseHubのようなRedditコメントスクレイパーは、クイックプロトタイプに本当に役立ちます。ブラウザ拡張機能を起動し、コメントツリー(著者、テキスト、アップボート、返信)をマッピングし、10分以内にCSVをエクスポートします。サーバーもスクリプトも不要です。ただのビジュアルセレクターでスレッドを引き出します。製品発売前にバイラルAMAからブランドの感情を測定する必要があるマーケターにとって、このようなセットアップは仕事を完了させます。

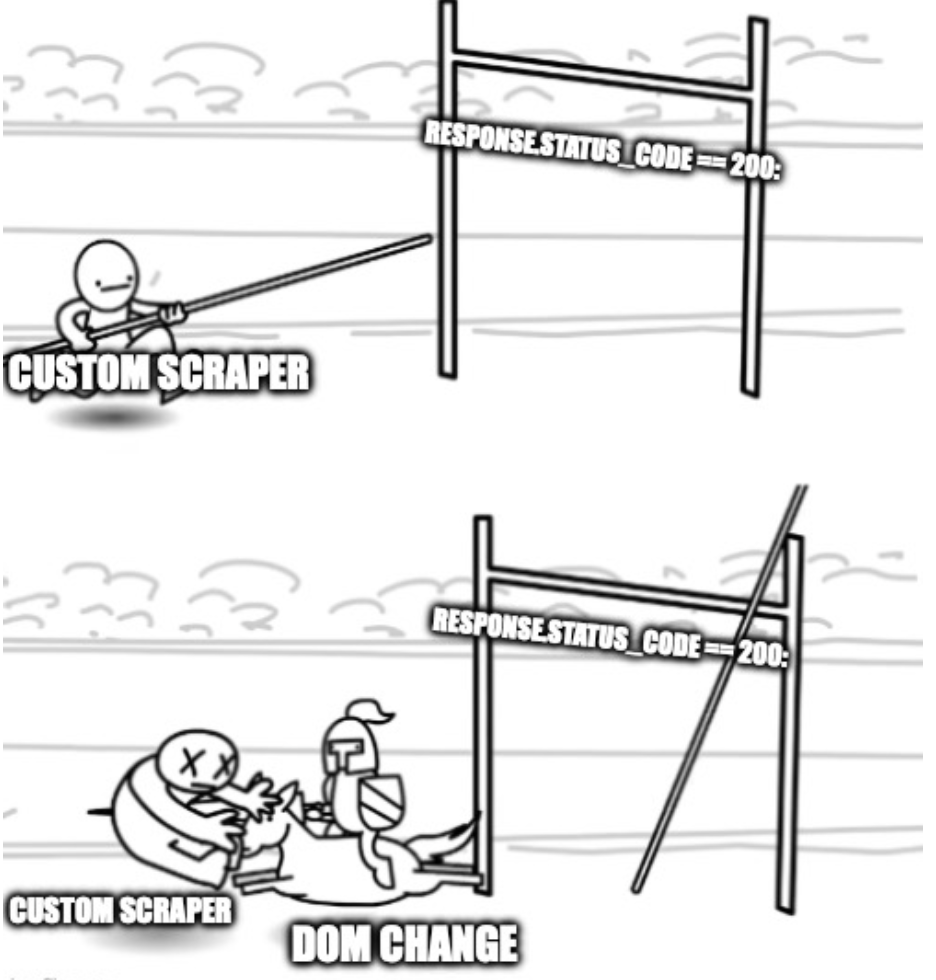

しかし、すぐに問題が発生します。Redditの動的読み込み(無限スクロール、遅延読み込みされた返信)は静的セレクターを欺きます。5kコメントを超えるとCAPTCHAが大量に発生し、セッションがタイムアウトし、ネストされたスレッドが完全に失われます。無料プランは月に10k行に制限されており、持続的なキャンペーンでは遠くまで行きません。

ブラウザ拡張機能とハイブリッドツール:プラグアンドプレイの魅力

ウェブスクレイピング拡張機能は、さらに一歩進んでいます。ワンクリックで設定し、DOMベースのコメント解析を行い、汗をかかずに100件のコメントを取得できます。Zapierと組み合わせてGoogle Sheetsに自動エクスポートすれば、合理的な週次モニタリングセットアップができます。

問題は?スケールです。Redditの2025年のボット対策アップグレード(行動指紋、JavaScriptチャレンジなど)は、実行中にIPを禁止し始めます。プロキシは一時的に役立ちますが、100以上をチェーンするのは月に50-100ドルかかり、すべてを遅くします。これはサードパーティのRedditコメントスクレイパーにとっては高すぎる価格のようです。

Python Redditコメントスクレイパー:痛みを伴う力

技術チームにとって、Pythonは自然な選択です。BeautifulSoup、Scrapy、PRAWのようなライブラリを使用すると、実際に有能な抽出器を構築できます。毎日r/businessスレッドをヒットするようにスケジュールし、すべてをPandasにパイプして分析します。

しかし、メンテナンスは容赦ありません。Redditのレート制限とセレクターのルーレットは、勢いをすぐに削いでしまいます。パターンは一貫しています:PythonベースのRedditコメントスクレイパーはスピードで引き寄せますが、ボリュームで失望させます。そこにAPIが登場します。

RedditコメントAPI:効率的な前進の道

APIは、スクレイピングの無法地帯のエネルギーを構造化された信頼性に交換します — 煩わしさなしにクリーンなJSONを返す安定したエンドポイントです。2026年には、効果的で実際の生産ワークフローに役立つスケールを組み合わせたプロフェッショナルスタンダードです。

2026年の公式Reddit API:堅実な基盤、厳しい制限

2023年のAPIgate論争の後、徹底的に見直された公式Reddit APIは、2026年のサービス利用規約を明確に示しています:OAuth 2.0認証が必要、クライアントIDごとに1分あたり100クエリ、ユーザー生成データの再販禁止。非商業利用は無料;商業アクセスは1,000回の呼び出しあたり$0.24から。

これは本当に研究者に優しいです。PythonのPRAWライブラリは統合を簡単にし、学術的な感情研究や軽量モニタリングのために1,000件のコメントを引き出すのは簡単です。

それでも、マーケターは壁にぶつかります。レート制限は、理想的な条件下でおおよそ1時間あたり60kコメントに制限され、バルクの過去のエンドポイントはなく、OAuthはチームベースのワークフローでは扱いにくくなります。

複数のサブレディットの集約や過去のトレンド分析が必要なキャンペーンには、RedditのネイティブAPIはプロトタイプツールとしてはうまく機能しますが、生産エンジンとしては持ちこたえません。

Data365ソーシャルメディアAPI:Redditマスタリーのためのエンタープライズスケール

Data365のソーシャルメディアAPIは、すでに上記の限界にぶつかっているチームのために構築されています。インフラの複雑さを自分で管理する代わりに、それを手放し、重要なことに集中します:データです。

このAPIは、サブレディット全体で必要なコメントの正確な量を毎日提供し、予測可能なパフォーマンスとプロキシの頭痛なしで — キーワードマイニングやソーシャルリスニングに最適です。統合プロセスはシンプルで、3ステップのPOST-GET-GET構造に従います。その後、99.9%の稼働率、安定したエンドポイント、専任のサポートチームが得られます。スクレイパーや公式APIと異なる点は以下の通りです:

- 過去のアクセス:スレッドにコメントが存在する限り引き出せます。

- 分析準備済みの出力:事前に構造化されたスレッドにより、バイラリティマッピングや感情トレンド分析の設定がはるかに簡単になります。

- 透明な価格設定:14日間無料でフルポテンシャルを体験し、クレジットベースのティアがあります。

- 専任のサポート:クエリを最適化するための24/7エンジニアリング支援。

ただし、すべてのプロジェクトに適した単一のツールはありません。以下に、各アプローチが機能するシナリオと機能しないシナリオの内訳を用意しました。

そして、主要なプレイヤーが誰で、誰がこのデータ取得ゲームのNPCに過ぎないかをすでに理解しているなら、私たちのマネージャーとの短い電話を予約し、手間なくRedditのインサイトを引き出し始めましょう。

スクレイパー対API:使用ケースに基づいて賢く選択

戦略的な要点は明確です:スクレイパーはアイデアを迅速に検証するのに優れています。Redditの公式APIは、低ボリュームの統合をクリーンにカバーします。信頼性、スケール、コンプライアンスが必要な生産システムでは、Data365がアップグレードパスです。以下の表を使って、各ツールをどこでいつ使用するかを簡単に把握できます。

| 状況 | ツール |

|---|---|

| 競合の感情を迅速にチェック(プロトタイプのサブレディットモニタリング、日次コメント) | スクレイパー:ノーコード、5分の設定;迅速なSheetsエクスポート |

| SEOキーワード分析(中規模のサブレディット全体) | API:生のRedditデータを含むクリーンなJSON |

| 予算テスト(迅速なサブレディットスキャン) | スクレイパー:低コストのプロトタイピングで低スケール |

| 学術的なテクノロジースタートアップの研究(サブレディット全体のグローバルスキャン) | API:専任の開発者による信頼できるアクセス |

| エンタープライズソーシャルリスニング(大規模サブレディット、リスク重視) | API:スケーラブルな稼働率と過去のアクセス |

RedditコメントスクレイパーまたはAPIを使用する決定は、技術的な決定よりもビジネスの決定です。妥当な出発点はスクレイパーです:安価で、設定が簡単で、単一のテストや概念を証明するのに十分です。

しかし、使用ケースが拡大するにつれて(より多くのサブレディット、大きなボリューム、出力に完全に依存するスタッフ)、隠れたコストが急速に増加し始めます。故障したセレクター、プロキシ料金、週末のデバッグは、一度だけ支払う税金ではなく、毎回支払わなければならない税金です。

APIは、Reddit自身が提供するものでも、Data365のような特定の目的のツールでも、その不確実性を信頼性というより価値のある特性で補償します。これは実際に計画できます。現在に生き、未来を計画してください。

今日からRedditデータ戦略をレベルアップ

スクレイパーはあなたをスタートさせます。APIはあなたを運行させます。メンテナンスが重いスクレイピングの脆弱性を超える準備ができているなら、Data365のRedditエンドポイントはチームが実際に最高の仕事をする場所です。無料ティアから始めて、ブランドモニタリング、SEOキーワード発見、競合分析に必要な量にスケールしてください。

始めるのは数分です:

- 技術マネージャーとの簡単な電話に参加してください。

- 個人のAPIキーと詳細なドキュメントガイドを取得します。

- 14日間の無料トライアル内で簡単なコードで最初のクエリを実行します。

あなたのRedditデータの課題は何ですか?過去のトレンド分析、リアルタイムブランドモニタリング、ネストされた会話のマッピングが必要であれば、Data365はRedditのノイズを実行可能な信号に変えるためのインフラを持っています — 抽出の頭痛なしで。

Data365 API を使用して主要なソーシャルメディアネットワークからデータを抽出

14 日間の無料試用版をリクエストして 20 種類以上のデータタイプを入手してください

.svg)

.svg)

.svg)

.svg)

.svg)

.svg)